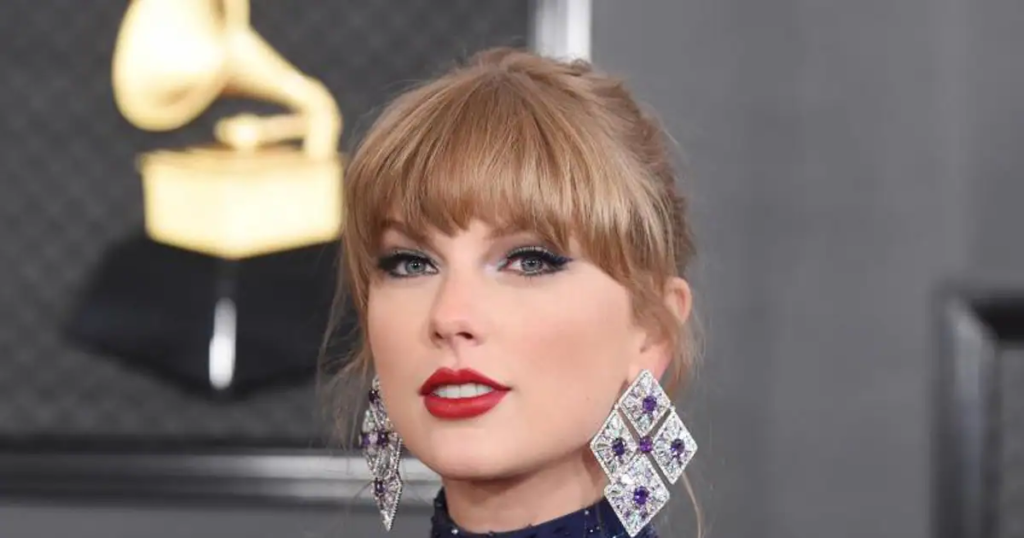

Es importante abordar con seriedad y responsabilidad el tema de las imágenes pornográficas generadas por inteligencia artificial que involucran a Taylor Swift, la reconocida estrella mundial. Estas imágenes se han difundido recientemente en las redes sociales, lo que destaca la preocupante capacidad de la tecnología de inteligencia artificial para crear contenido visual convincentemente real y perjudicial.

Este incidente pone de relieve los riesgos inherentes a la prevalencia de la inteligencia artificial y la necesidad de establecer medidas efectivas para prevenir la creación y distribución de contenido inapropiado. Además, subraya la importancia de la ética y la regulación en el desarrollo y uso de estas tecnologías, con el fin de salvaguardar la integridad y privacidad de las personas afectadas.

Es esencial fomentar un diálogo informado y responsable sobre la influencia de la inteligencia artificial en la sociedad, así como impulsar la adopción de medidas que protejan a las personas de posibles abusos y violaciones de privacidad.

Las imágenes falsas de Taylor Swift circularon principalmente en la red social X, anteriormente conocida como Twitter. Estas representaciones, que mostraban a la cantante en posturas sexualmente sugerentes y explícitas, fueron visualizadas por decenas de millones de personas antes de ser retiradas de las plataformas sociales. Sin embargo, en el mundo digital, nada desaparece para siempre, y es probable que continúen siendo compartidas en canales menos regulados.

A pesar de la magnitud del incidente, el portavoz de Swift no respondió a la solicitud de comentarios.

Similar a la mayoría de las principales plataformas de medios sociales, las políticas de X prohíben compartir «medios sintéticos, manipulados o fuera de contexto que puedan engañar o confundir a las personas y causar daño».

Hasta el momento, la empresa no ha respondido a la solicitud de comentarios de CNN. Este caso destaca la importancia de abordar los desafíos asociados con la difusión de contenido manipulado en plataformas digitales y la necesidad de reforzar las políticas para proteger la integridad y privacidad de los individuos afectados.

El suceso tiene lugar en un momento crítico en Estados Unidos, ya que el país se embarca en un año de elecciones presidenciales. Aumenta la inquietud sobre la posibilidad de que imágenes y videos falsos, generados por inteligencia artificial, sean utilizados para liderar campañas de desinformación, con el potencial de interferir de manera sustancial en el proceso de votación. Este contexto subraya la necesidad urgente de abordar las amenazas emergentes asociadas con la manipulación mediática y garantizar la integridad del proceso democrático.

«Este caso ejemplifica de manera destacada cómo la inteligencia artificial se utiliza con propósitos perjudiciales, sin contar con suficientes salvaguardas para proteger la esfera pública», comentó a CNN Ben Decker, director de Memetica, una agencia especializada en investigación digital.

Decker señaló que la explotación de herramientas de inteligencia artificial generativa para la creación de contenido potencialmente perjudicial dirigido a figuras públicas está experimentando un rápido aumento y se está difundiendo a una velocidad sin precedentes a través de las redes sociales.

«Las empresas de redes sociales carecen, en realidad, de planes eficaces para supervisar el contenido», afirmó. Este panorama subraya la urgencia de implementar medidas más efectivas para monitorear y mitigar el uso indebido de la inteligencia artificial en la creación y difusión de contenido dañino en plataformas digitales.

X, por ejemplo, ha reducido considerablemente su equipo de moderación de contenidos y depende en gran medida de sistemas automatizados y de los informes de los usuarios. (La Unión Europea está actualmente investigando a X por sus prácticas de moderación de contenidos).

Asimismo, se informa que Meta ha disminuido la fuerza de trabajo encargada de combatir la desinformación, las campañas coordinadas de trolls y el acoso en sus plataformas, según fuentes con conocimiento directo de la situación, generando inquietud en vista de las cruciales elecciones de 2024 tanto en Estados Unidos como en todo el mundo.

La procedencia exacta de las imágenes relacionadas con Taylor Swift no está clara. Aunque algunas de ellas fueron identificadas en sitios como Instagram y Reddit, el fenómeno parece haberse generalizado especialmente en X.

El incidente también coincide con el auge de herramientas de generación de inteligencia artificial, como ChatGPT y Dall-E. No obstante, según Decker, existe un panorama mucho más amplio de modelos de inteligencia artificial no moderados y no seguros disponibles en plataformas de código abierto.

«Esto refleja una fractura significativa en la moderación de contenidos y la gobernanza de las plataformas. Si todas las partes interesadas, incluidas las empresas de inteligencia artificial, las redes sociales, los reguladores y la sociedad civil, no están abordando estas cuestiones de manera uniforme, este tipo de contenido continuará proliferando», agregó Decker. Este escenario destaca la urgencia de un diálogo y una colaboración efectivos entre todas las partes involucradas para abordar los desafíos derivados del uso irresponsable de la inteligencia artificial en la generación de contenido.

Decker señaló, sin embargo, que el hecho de que Taylor Swift esté siendo objeto de atención podría poner de relieve de manera más intensa los crecientes problemas relacionados con las imágenes generadas por inteligencia artificial. La masiva comunidad de «Swifties», leales seguidores de Swift, expresó su indignación en las redes sociales esta semana, llevando el tema a la primera plana de la discusión pública.

En el año 2022, un colapso de Ticketmaster antes de uno de sus conciertos del Eras Tour desató la furia en Internet, lo que resultó en diversos esfuerzos legislativos para combatir las políticas desfavorables a los consumidores en la venta de entradas.

Decker sugiere que podríamos presenciar un fenómeno similar con las imágenes perjudiciales generadas por la inteligencia artificial.

«Cuando figuras tan destacadas como Taylor Swift se convierten en blanco de tal magnitud, esto podría motivar a legisladores y empresas tecnológicas a tomar medidas, ya que no pueden permitirse enfrentarse a una campaña pública en su contra por parte de la ‘novia de Estados Unidos'», afirmó. «Diría que necesitan abordar la situación para brindarle apoyo, dado que probablemente tiene más influencia que casi cualquier otra persona en Internet».

Esta tecnología ha sido empleada durante mucho tiempo para generar lo que se denomina «porno de venganza», que implica la publicación no consensuada de imágenes explícitas de alguien en Internet. Sin embargo, ahora está captando una atención renovada debido a las imágenes ofensivas de Taylor Swift.

En la actualidad, nueve estados de EE. UU. cuentan con leyes que prohíben la creación o el intercambio no consensuado de imágenes «deepfake», es decir, imágenes artificiales diseñadas para imitar la apariencia real de una persona. Este enfoque legal busca abordar los riesgos asociados con la proliferación de contenido manipulado que puede causar daño significativo a la privacidad y reputación de las personas involucradas.